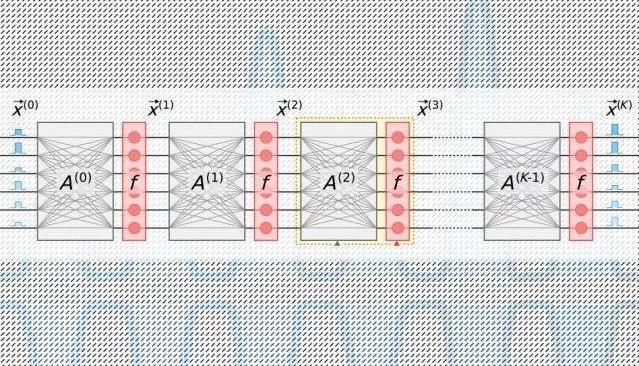

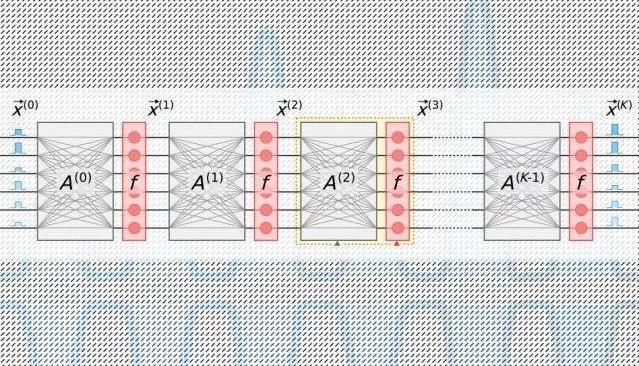

神经网络是一种机器学习模型,广泛应用于机器人目标识别、自然语言处理、药物开发、医学成像和驾驶无人驾驶汽车等领域。使用光学现象加速计算的新光学神经网络可以比其他电子同行运行得更快、更有效。然而,随着传统神经网络和光学神经网络变得越来越复杂,它们消耗了大量的能量。为了解决这个问题,包括谷歌、IBM和特斯拉在内的研究人员和各大科技公司开发了“人工智能加速器”,这是一种专门的芯片,可以提高训练和测试神经网络的速度和效率。对于电子芯片,包括大部分人工智能加速器,都有一个理论上的最小能耗极限。最近,麻省理工学院的研究人员开始为光学神经网络开发光子加速器。这些芯片在数量级上更有效,但它们依赖于一些笨重的光学元件,这限制了它们在相对较小的神经网络中的使用。在发表于《物理评论X》的论文中,麻省理工学院的研究人员描述了一种新型的光子加速器,它使用更紧凑的光学元件和光信号处理技术,大大降低了功耗和芯片面积。这使得芯片可以扩展到神经网络,比相应的芯片大几个数量级。神经网络在MNIST图像分类数据集上的仿真训练表明,该加速器理论上可以处理神经网络,比传统电子加速器的能耗极限低1000万倍以上,比光子加速器低1000倍左右。研究人员现在正在开发一种原型芯片,通过实验证明这一结果。“人们正在寻找一种可以超出基本能耗限制进行计算的技术,”电子研究实验室的博士后Ryan Hamerly说。“光子加速器非常有前途...但我们的动机是建立一个可以大规模扩展的神经网络。”这些技术的实际应用包括降低数据中心的能耗。“对运行大型神经网络的数据中心的需求越来越大,随着需求的增长,计算变得越来越困难,”电子研究实验室的合著者和研究生亚历山大·斯鲁德斯(Alexander Sludds)说,旨在“利用神经网络硬件来满足计算需求……以解决能耗和延迟的瓶颈”。与Sludds和Hamerly合著这篇论文的有:RLE研究生、合著者Liane Bernstein;马林·索尔贾西奇;,麻省理工学院物理学教授;德克·英格伦;麻省理工学院电子工程和计算机科学副教授;他是RLE大学的研究员和量子光子学实验室的负责人。依靠更紧凑和节能的“光电”方案,神经网络通过包括互连节点(称为“神经元”)在内的许多计算层来处理数据,从而在数据中找到模式。神经元从其上游“邻居”接收输入,并计算输出信号,该信号被发送到更下游的神经元。每个输入还被分配一个“权重”,这是一个基于它对所有其他输入的相对重要性的值。随着数据在各层的“深入”传播,网络逐渐学习到更复杂的信息。最后,输出层根据整个层的计算生成预测。所有人工智能加速器的目标都是减少神经网络中特定线性代数步骤(称为“矩阵乘法”)中处理和移动数据所需的能量。在那里,神经元和权重被编码到单独的行和列表中,然后组合起来计算输出。在传统的光子加速器中,脉冲激光将每个神经元的信息编码成一层,然后流入波导,通过分束器。产生的光信号被发送到一个名为“马赫-曾德尔干涉仪”的正方形光学元件网格,该网格被编程为执行矩阵乘法。干涉仪利用每个权值的信息进行编码,利用信号干涉技术对光信号和权值进行处理,计算出每个神经元的输出。但是有一个缩放问题:对于每个神经元,必须有一个波导,对于每个重量,必须有一个干涉仪。由于重量与神经元的数量成正比,这些干涉仪占据了很大的空间。“你很快就会意识到,输入神经元的数量永远不会超过100个左右,因为你无法在芯片上安装这么多组件,”哈默利说。“如果你的光子加速器每层不能处理100个以上的神经元,就很难将大型神经网络应用于这种结构。”研究人员的芯片依赖于更紧凑和节能的“光电”方案,该方案使用光信号对数据进行编码,但使用“平衡零差检测”进行矩阵乘法。这是一种在计算两个光信号的振幅(波高)的乘积之后产生可测量的电信号的技术。光脉冲编码的信息流经输入和输出神经元的每个神经网络层中的单个通道,用于训练网络。用矩阵乘法表中的整行权重信息编码的各个脉冲流经各个通道。将神经元和重量数据传输到零差光电探测器网格的光信号。光电探测器使用信号的幅度来计算每个神经元的输出值。每个检测器将每个神经元的电输出信号输入调制器,调制器将信号转换回光脉冲。光信号成为下一层的输入,依此类推。这种设计每个输入输出神经元只需要一个通道,只需要和神经元一样多的零拍光电探测器,没有重量。由于神经元的数量总是远远小于重量,节省了大量的空间,因此该芯片可以扩展到每层超过一百万个神经元的神经网络。用光子加速器找最好的,信号中会有不可避免的噪声。注入芯片的光越多,噪音越少,精度越高——但这将变得非常低效。输入光越少,效率越高,但会对神经网络的性能产生负面影响。但伯恩斯坦说,有一个“最佳点”,即在保持精度的同时使用最小的光功率。人工智能加速器的最佳位置是通过执行两个数相乘的单个运算(如矩阵乘法)需要多少焦耳来衡量的。目前传统的加速器是以皮焦耳或万亿焦耳为单位来测量的。光子加速器是用阿托约尔斯测量的,效率要高一百万倍。在模拟中,研究人员发现他们的光子加速器可以以比attojoules更低的效率运行。“在失去准确性之前,你可以发送一些最小光功率。我们芯片的基本限制比传统加速器低得多.....并且比其他光子加速器的要低,”伯恩斯坦说。

神经网络是一种机器学习模型,广泛应用于机器人目标识别、自然语言处理、药物开发、医学成像和驾驶等领域美国的汽车。使用光学现象加速计算的新光学神经网络可以比其他电子同行运行得更快、更有效。然而,随着传统神经网络和光学神经网络变得越来越复杂,它们消耗了大量的能量。为了解决这个问题,包括谷歌、IBM和特斯拉在内的研究人员和各大科技公司开发了“人工智能加速器”,这是一种专门的芯片,可以提高训练和测试神经网络的速度和效率。对于电子芯片,包括大部分人工智能加速器,都有一个理论上的最小能耗极限。最近,麻省理工学院的研究人员开始为光学神经网络开发光子加速器。这些芯片在数量级上更有效,但它们依赖于一些笨重的光学元件,这限制了它们在相对较小的神经网络中的使用。在发表于《物理评论X》的论文中,麻省理工学院的研究人员描述了一种新型的光子加速器,它使用更紧凑的光学元件和光信号处理技术,大大降低了功耗和芯片面积。这使得芯片可以扩展到神经网络,比相应的芯片大几个数量级。神经网络在MNIST图像分类数据集上的仿真训练表明,该加速器理论上可以处理神经网络,比传统电子加速器的能耗极限低1000万倍以上,比光子加速器低1000倍左右。研究人员现在正在开发一种原型芯片,通过实验证明这一结果。“人们正在寻找一种可以超出基本能耗限制进行计算的技术,”电子研究实验室的博士后Ryan Hamerly说。“光子加速器非常有前途...但我们的动机是建立一个可以大规模扩展的神经网络。”这些技术的实际应用包括降低数据中心的能耗。“对运行大型神经网络的数据中心的需求越来越大,随着需求的增长,计算变得越来越困难,”电子研究实验室的合著者和研究生亚历山大·斯鲁德斯(Alexander Sludds)说,旨在“利用神经网络硬件来满足计算需求……以解决能耗和延迟的瓶颈”。与Sludds和Hamerly合著这篇论文的有:RLE研究生、合著者Liane Bernstein;马林·索尔贾西奇;,麻省理工学院物理学教授;德克·英格伦;麻省理工学院电子工程和计算机科学副教授;他是RLE大学的研究员和量子光子学实验室的负责人。依靠更紧凑和节能的“光电”方案,神经网络通过包括互连节点(称为“神经元”)在内的许多计算层来处理数据,从而在数据中找到模式。神经元从其上游“邻居”接收输入,并计算输出信号,该信号被发送到更下游的神经元。每个输入还被分配一个“权重”,这是一个基于它对所有其他输入的相对重要性的值。随着数据在各层的“深入”传播,网络逐渐学习到更复杂的信息。最后,输出层根据整个层的计算生成预测。所有人工智能加速器的目标都是减少神经网络中特定线性代数步骤(称为“矩阵乘法”)中处理和移动数据所需的能量。在那里,神经元和权重被编码到单独的行和列表中,然后组合起来计算输出。在传统的光子加速器中,脉冲激光将每个神经元的信息编码成一层,然后流入波导,通过分束器。产生的光信号被发送到一个名为“马赫-曾德尔干涉仪”的正方形光学元件网格,该网格被编程为执行矩阵乘法。干涉仪利用每个权值的信息进行编码,利用信号干涉技术对光信号和权值进行处理,计算出每个神经元的输出。但是有一个缩放问题:对于每个神经元,必须有一个波导,对于每个重量,必须有一个干涉仪。由于重量与神经元的数量成正比,这些干涉仪占据了很大的空间。“你很快就会意识到,输入神经元的数量永远不会超过100个左右,因为你无法在芯片上安装这么多组件,”哈默利说。“如果你的光子加速器每层不能处理100个以上的神经元,就很难将大型神经网络应用于这种结构。”研究人员的芯片依赖于更紧凑和节能的“光电”方案,该方案使用光信号对数据进行编码,但使用“平衡零差检测”进行矩阵乘法。这是一种在计算两个光信号的振幅(波高)的乘积之后产生可测量的电信号的技术。光脉冲编码的信息流经输入和输出神经元的每个神经网络层中的单个通道,用于训练网络。用矩阵乘法表中的整行权重信息编码的各个脉冲流经各个通道。将神经元和重量数据传输到零差光电探测器网格的光信号。光电探测器使用信号的幅度来计算每个神经元的输出值。每个检测器将每个神经元的电输出信号输入调制器,调制器将信号转换回光脉冲。光信号成为下一层的输入,依此类推。这种设计每个输入输出神经元只需要一个通道,只需要和神经元一样多的零拍光电探测器,没有重量。由于神经元的数量总是远远小于重量,节省了大量的空间,因此该芯片可以扩展到每层超过一百万个神经元的神经网络。用光子加速器找最好的,信号中会有不可避免的噪声。注入芯片的光越多,噪音越少,精度越高——但这将变得非常低效。输入光越少,效率越高,但会对神经网络的性能产生负面影响。但伯恩斯坦说,有一个“最佳点”,即在保持精度的同时使用最小的光功率。人工智能加速器的最佳位置是通过执行两个数相乘的单个运算(如矩阵乘法)需要多少焦耳来衡量的。目前传统的加速器是以皮焦耳或万亿焦耳为单位来测量的。光子加速器是用阿托约尔斯测量的,效率要高一百万倍。在模拟中,研究人员发现他们的光子加速器可以以比attojoules更低的效率运行。“在失去准确性之前,你可以发送一些最小光功率。我们芯片的基本限制比传统加速器低得多.....并且比其他光子加速器的要低,”伯恩斯坦说。

近年来,氢能产业的热度正在直线攀升。

1900/1/1 0:00:00在车联网领域,汽车科技巨头联合主机厂共同讲故事的模式早已不是什么新鲜事物。

1900/1/1 0:00:00即便江淮在传统燃油乘用车版块表现失色,但江淮的根基商用车并没有受到太大影响。不过,时间来到2019年之后,就忽然出现了微妙的变化。

1900/1/1 0:00:006月10日,蔚来汽车宣布NIOPilot自动辅助驾驶系统升级,本次新增7项功能;同时推送升级的还有NIOOS20智能操作系统,升级为全新的UX交互和UI设计。

1900/1/1 0:00:00图片来自“123rfcomcn”6月中旬的短短三日内,专注于自动驾驶技术研发的硅谷初创公司Aurora连续爆出了三则重大新闻:与FCA成功牵手,获得现代汽车集团的投资,被大众正式提出分手。

1900/1/1 0:00:00领克01销量再次腰斩,风光一去不复回。6月10日晚,吉利汽车披露了5月月报。其中,领克全系销量下滑,仅有9190辆。

1900/1/1 0:00:00